Por Octavio Santos

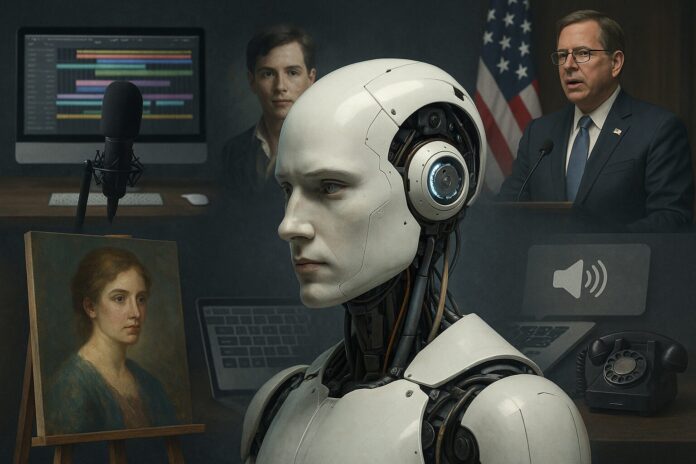

La inteligencia artificial ya está metida en la música, en el cine, en el periodismo, en la pintura, en la política y hasta en tu buzón de voz. Y no está pidiendo permiso. La pregunta dejó de ser “¿vamos a usar IA?” y pasó a ser otra, mucho más incómoda: ¿cómo le vamos a poner límites sin matar lo bueno?

Porque lo bueno existe. Y es grande.

Pero lo malo también es real. Y ya está pasando.

Vamos por partes.

Lo bueno: poder creativo barato

La IA hoy puede escribir una canción desde cero, generar una portada en 4 segundos, escalar una voz humana a cualquier idioma, recrear a un actor joven sin cirugía y ayudarte a armar un guion en una madrugada sin café. Eso, para la industria creativa, es dinamita.

En música, modelos de audio generativo ya componen instrumentales completos y hasta imitan voces. Eso reduce costos y barreras: un chamaco con una laptop puede producir algo que suena a estudio profesional sin necesitar estudio profesional.

En cine es parecido. Antes, rejuvenecer a un actor era trabajo de cientos de horas de efectos visuales. Ahora hay modelos de IA que ajustan la cara, la piel, las arrugas, el movimiento de la boca y la sincronía de la voz de manera creíble. Para el productor, eso significa escenas que antes eran imposibles o carísimas. Ahora son viables. Para el público, significa que puedes ver a un Harrison Ford de 40 años en 2025.

En artes visuales, la revolución es todavía más bruta: texto → imagen. Tú escribes “retrato en luz dura al estilo óleo clásico con textura de pincel visible” y la IA te da cinco opciones de alta resolución. Ilustradores, publicistas y diseñadores independientes ya están usando eso como borrador, moodboard y maqueta. Donde antes había que contratar tres rondas de bocetos, ahora el cliente llega con “algo así” hecho por IA y dice: termina esto en tu estilo.

En redacción, los modelos de lenguaje ya sirven como asistentes creativos. No reemplazan la voz humana, pero sí resuelven tareas pesadas: resumen de documentos, limpieza de estilo, generación de primeras versiones de un texto. Un periodista puede pedir un borrador inicial para una nota técnica y luego hacer el trabajo humano: verificar, contextualizar, editar y asumir responsabilidad. Un guionista puede hacer que la IA le proponga variaciones de una escena con cambios de tono (“hazla más oscura”, “hazla irónica”), y así acelerar la iteración.

Traducción automática y clonación de voz también están cambiando la escala. Un creador de YouTube puede grabar un video en español y publicar la “misma” pieza en inglés, con su propia voz clonada sonando natural, labios sincronizados, sin tener que pagar doblaje. Eso es distribución global low-budget. Eso es competencia directa con medios que antes dominaban sólo porque tenían departamento de localización.

Y, ojo, hay otro ángulo: accesibilidad. IA ya está generando descripciones de imágenes para personas ciegas, generando subtítulos en vivo, limpiando audio con ruido para que una entrevista grabada en la calle suene como estudio. Eso no es amenaza; eso es inclusión. Eso sí es progreso claro.

Entonces, sí: herramientas de IA creativa hacen más fácil entrar al juego. Hacen más barato producir. Hacen más rápido experimentar. Abren puertas a gente que nunca habría podido pagar esa puerta.

Hasta aquí, todo bello.

Ahora viene el costo.

El choque: ¿de quién es esto?

Para entrenar esos modelos que parecen magia hay que alimentarlos. ¿Alimentarlos con qué? Con obra humana.

Canciones. Libros. Ilustraciones. Guiones. Voces. Caras.

Y ahí se puso ácido.

Ejemplo directo: en 2023 se hizo viral una canción con la supuesta voz de Drake y The Weeknd. No eran ellos. Era IA. La canción sonaba como ellos, tenía letras nuevas, pero explotaba la marca vocal de dos artistas reales. La disquera reaccionó como si le hubieran intentado robar el banco. ¿Por qué? Porque si cualquiera puede clonar tu voz y sacar música que parece tuya, ¿cuánto vale tu voz?

Hollywood vivió su propia versión del susto. Durante la huelga de actores en 2023, una de las quejas más serias era ésta: los estudios querían escanear a los extras en alta resolución y quedarse con esos dobles digitales para usarlos cuando quisieran. Traducción: págame un día hoy y después uso tu cara, tu cuerpo y tu caminar en el fondo de diez series más sin volverte a pagar. Eso pasó de “rumor” a “línea roja sindical”. Los actores dijeron: no, mi cara no es trabajo gratis. Mi cara es mi trabajo.

Los escritores hicieron exactamente la misma pregunta con las palabras. Autores de best sellers demandaron a las grandes compañías de IA diciendo: ustedes entrenaron su modelo con mis novelas completas sin permiso y ahora su modelo puede escribir “algo estilo yo”. Si la máquina puede producir textos que suenan como yo, generar resúmenes detallados de mis libros y hasta responder preguntas sobre escenas que sólo están en mis páginas, ¿me estás usando a mí como insumo? ¿O me estás reemplazando?

La respuesta técnica de las empresas suele ser: “no estamos copiando tus obras, estamos aprendiendo patrones estadísticos; es uso transformador”. La respuesta emocional de los creadores es: “me escanearon la cabeza sin preguntarme”.

Y no es sólo emoción. Hay dinero real aquí. Si una IA puede hacer un póster “al estilo de tu ilustrador favorito”, el cliente pequeño quizás deja de contratar al ilustrador favorito. Si un portal mediocre publica artículos de relleno escritos por IA, satura las búsquedas con textos baratos y desplaza a reporteros humanos en Google. Si aparecen canciones deepfake con tu voz, tu marca se diluye y tu negocio se contamina. Hay impacto económico directo.

Traducción sencilla: la IA abarata la creación… usando como materia prima la creación previa de otra gente. Y esa gente no siempre cobra.

El momento legal: la ley está atrás

Estados Unidos está en medio del pleito y todavía no tiene la respuesta definitiva.

Algunos frentes:

- Derechos de autor. Hoy, bajo la ley estadounidense, sólo las obras con aporte creativo humano pueden tener copyright. Una imagen generada 100% por IA no califica. Eso significa que, por ahora, nadie “posee” legalmente la imagen que hizo la máquina sola. Buenísimo si eres usuario (puedes usarla sin pagar regalías). Complicado si eres la empresa que generó esa imagen (no puedes reclamar exclusividad).

- Entrenamiento. ¿Es legal entrenar una IA con millones de obras protegidas sin permiso? Las tecnológicas dicen: “fair use”. Los artistas dicen: “piratería masiva con otro nombre”. No está resuelto. Los jueces federales ya aceptaron que al menos hay base para discutir que copiar obras enteras para entrenar modelos puede violar el derecho de reproducción.

- Imagen y voz. Ahí hay más avance. La imagen y la voz de una persona en EE. UU. están protegidas por leyes de “right of publicity” (derecho de imagen). Eso significa: no puedes usar mi cara, ni mi voz, ni mi nombre para vender cosas sin mi permiso. Ese marco se está actualizando para incluir clones digitales.

- Etiquetado. Hay empuje político para obligar a que el contenido hecho por IA venga marcado. Especialmente en publicidad política. Traducción práctica: si vas a sacar un anuncio con imágenes generadas por IA diciendo que “tal candidato hundió el país”, vas a tener que admitir en pantalla que eso es fabricado digitalmente.

Todo esto está en desarrollo. Nada está cerrado. Es territorio en disputa.

El lado oscuro: la realidad ya no es evidencia

Lo más inquietante de la IA no es que haga canciones ni portadas. Es que puede fabricar realidad.

Tú puedes hoy generar un video donde una persona dice palabras que nunca dijo. Con su cara. Con su voz. Con expresiones creíbles. Eso ya se ha usado para intentar manipular la opinión pública, humillar mujeres con pornografía falsa o incluso cometer fraude (“Mami, soy yo, estoy en problemas, mándame dinero ahora”).

Antes uno podía decir: “míralo en video, está grabado, es verdad”. Ese piso se rompió. Ahora hay que probar que algo es real, no que es falso. Es un giro brutal.

Y esto pega en política, pega en justicia, pega en reputación personal y pega en periodismo. En campaña electoral, un deepfake bien hecho lanzado a la hora correcta puede incendiar redes, mover votos, sembrar dudas. Los expertos lo llaman “el dividendo del mentiroso”: ya no importa qué pasó, siempre habrá espacio para decir “eso es un montaje”. Incluso cuando no lo es.

Esto es incómodo porque somos criaturas visuales. Creemos lo que vemos. Ver va a dejar de ser prueba.

¿Entonces, qué hacemos con la IA?

Hay dos tentaciones peligrosas: una, abrazarla sin reglas, porque “el futuro es inevitable”; dos, demonizarla entera como si fuera la muerte del arte.

Las dos son flojas.